Mein Buch zum Download

Wie die Zeit vergeht… Testgetriebene Entwicklung mit JUnit und FIT ist nunmehr sieben Jahre alt. Ich habe damals versucht, die TDD-Techniken so zeitlos wie möglich zu beschreiben. Doch natürlich haben sich seitdem eine Reihe neuer Werkzeuge und Ideen hinzugesellt. Im Ruby-Umfeld beispielsweise sind BDD und rSpec mehr oder weniger die Norm. Open Source ohne Unit Tests ist selten, wenn nicht undenkbar geworden. Wie zu erwarten war, sind jedoch nicht alle unsere Ideen kleben geblieben. Aber ein paar schon. Vielleicht die wichtigsten.

Auch sieben Jahre später bin ich mit meinem Text immer noch überraschend einverstanden. Einzig wünschte ich mir, ich hätte den Kontext der Techniken im Buch damals besser herausgestellt. Test-Driven Development sind Best Practices. Best Practices existieren in einem wohl definierten Kontext. Der Untertitel "Wie Software änderbar bleibt" und insbesondere das letzte Buchkapitel "Änderbare Software" geben einen Hinweis, aber der meiner Meinung nach wichtigste Trade-off bleibt, langlebige Software zu entwickeln. In Open Source ist diese Voraussetzung stets gegeben. Im Startup dagegen kann der Kontext ein gänzlich anderer sein. Bei Rivva sind meine Tests zum Beispiel viel mehr risikogetrieben. Und natürlich hätte das Buch für eine andere Programmiersprache auch eine andere Gestalt angenommen. In Ruby entwickle ich fast ausnahmslos REPL-getrieben.

Das Buch ist mittlerweile vergriffen und nicht mehr im Druck. Deshalb freue ich mich, dass der dpunkt.verlag mir jetzt sein Einverständnis gegeben hat, das Buch als kostenloses eBook veröffentlichen zu können. Mein besonderer Dank dafür gilt meiner Lektorin Christa Preisendanz.

Download: Testgetriebene Entwicklung mit JUnit & FIT (PDF)

Happy 100th Birthday, Mr. Alan Turing (1912-1954).

Frank Westphal

Testgetriebene Entwicklung

mit JUnit & FIT:

Wie Software änderbar bleibt

dpunkt.verlag![]()

346 Seiten

November 2005

ISBN 3-89864-220-8

Bei Amazon ansehen

Buch zum Download: Testgetriebene Entwicklung mit JUnit & FIT (PDF)

Beschreibung

Testgetriebene Entwicklung geht von einem fehlschlagenden Test aus. Software wird in kleinen sicheren Schritten entwickelt, die abwechselnd darauf abzielen, eine neue Anforderung zu implementieren (den fehlschlagenden Test also zu erfüllen) und das Design zu verbessern (und dabei weiterhin alle Tests zu bestehen).

- Wenn frühes und häufiges Testen wichtig ist, warum schreiben wir nicht für jedes neue Feature zuerst einen automatisierten Test? So können wir während der Entwicklung jederzeit unsere Tests ausführen und lernen, ob unser Code wie gewünscht funktioniert.

- Wenn Design wichtig ist, warum investieren wir dann nicht Tag für Tag darin? So können wir dafür sorgen, dass es möglichst einfach bleibt und nicht mit der Zeit zunehmend degeneriert.

- Wenn Anforderungsdefinition wichtig ist, warum ermöglichen wir unseren Kunden dann nicht, in einem ausführbaren Anforderungsdokument Testfälle für konkrete Anwendungsbeispiele zu spezifizieren? So können wir dokumentieren, welche Funktionalität tatsächlich gefordert ist, und anschließend verifizieren, ob die Erwartungen des Kunden erfüllt werden.

Das Buch führt mit praktischen Beispielen in die Testgetriebene Entwicklung mit den Open-Source-Werkzeugen JUnit und FIT ein.

Frank Westphal has turned his extensive experience in using and teaching developer testing with JUnit and FIT into a thorough and usable guide for programmers and testers, including the first published guide to JUnit 4.

What I was most struck by in reading this book was the combination of philosophical background and detailed, practical advice.

– Kent Beck, Three Rivers Institute

Amazon-Rezensionen

ganz aus dem häuschen

– Thomas Steinbach

Warum sind wir darauf nicht schon eher gekommen?

– H. Mausolf

Grandios !!

– Bernd Will

Lockere Lektüre für flotte Erfolge

– Gernot Starke

Motivation für die Praxis

– Frankmartin Wiethüchter

Seit langem kein Buch mehr so schnell durchgearbeitet!

– Ulrich Storck

Rundum gelungen

– Jens Uwe Pipka

Übers Entwickeln und Entwerfen - auf testgetriebene Art

– Christoph Steindl

Ideal für professionelle Softwareentwickler

– Dierk König

Testen als Mittel zum Zweck

– Stefan Roock

Buchbesprechungen

- Amazon.de Kundenrezensionen

-

Alexander Hansen

-

Dirk Frischalowski

(Java Magazin 3.2006)

(Java Magazin 3.2006) -

Horst Franzke

- Stefan Roock

Inhaltsverzeichnis

Geleitwort von Johannes Link (PDF)

Kapitel 1: Einleitung (PDF)

- Was ist Testgetriebene Entwicklung?

- Warum Testgetriebene Entwicklung?

- Über dieses Buch

- Merci beaucoup

Kapitel 2: Testgetriebene Entwicklung, über die Schulter geschaut

- Eine Programmierepisode

- Testgetriebenes Programmieren

- Möglichst einfaches Design

- Ein wenig Testen, ein wenig Programmieren ...

- Evolutionäres Design

- Natürlicher Abschluss einer Programmierepisode

- Refactoring

- Abschließende Reflexion

- Häufige Integration

- Rückblende

- "Aus dem Bauch" von Sabine Embacher

Kapitel 3: Unit Tests mit JUnit (PDF)

- Download und Installation

- Ein erstes Beispiel

- Anatomie eines Testfalls

- Test-First

- JUnit in Eclipse

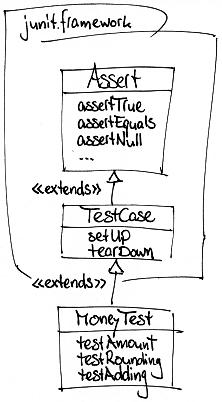

- Das JUnit-Framework von innen

- »Assert«

- »AssertionFailedError«

- »TestCase«

- Lebenszyklus eines Testfalls

- »TestSuite«

- »TestRunner«

- Zwei Methoden, die das Testen vereinfachen

- Testen von Exceptions

- Unerwartete Exceptions

- "Woran erkennt man, dass etwas testgetrieben entwickelt wurde?" von Johannes Link

- JUnit 4

Kapitel 4: Testgetriebene Programmierung

- Die erste Direktive

- Der Testgetriebene Entwicklungszyklus

- Die Programmierzüge

- Beginn einer Testepisode

- Ein einfacher Testplan

- Erst ein neuer Test ...

- ... dann den Test fehlschlagen sehen

- ... schließlich den Test erfüllen

- Zusammenspiel von Test- und Programmcode

- Ausnahmebehandlung

- Ein unerwarteter Erfolg

- Ein unerwarteter Fehlschlag

- "Rückschritt für den Fortschritt" von Tammo Freese

- Vorprogrammierte Schwierigkeiten

- "Zwei offene Tests sind einer zu viel" von Tammo Freese

- Kleine Schritte gehen

- "Halten Sie Ihre Füße trocken" von Michael Feathers

Kapitel 5: Refactoring

- Die zweite Direktive

- Die Refactoringzüge

- Von übel riechendem Code ...

- ... über den Refactoringkatalog

- ... zur Einfachen Form

- Überlegungen zur Refactoringroute

- Substitution einer Implementierung

- Evolution einer Schnittstelle

- "Coding Standards bewusst verletzen" von Tammo Freese

- Teilen von Klassen

- Verschieben von Tests

- Abstraktion statt Duplikation

- Die letzte Durchsicht

- Ist Design tot?

- "Durch zerbrochene Fenster dringen Gerüche ein" von Dave Thomas & Andy Hunt

- Richtungswechsel ...

- ... und der wegweisende Test

- Fake it ('til you make it)

- Vom Bekannten zum Unbekannten

- Retrospektive

- Tour de Design évolutionnaire

- Durchbrüche erleben

Kapitel 6: Häufige Integration

- Die dritte Direktive

- Die Integrationszüge

- Änderungen mehrmals täglich zusammenführen ...

- "Taxi implements Throwable" von Olaf Kock

- ... das System von Grund auf neu bauen

- ... und ausliefern

- Versionsverwaltung (mit CVS oder Subversion)

- Build-Skript mit Ant

- Build-Prozess-Tuning

- Integrationsserver mit CruiseControl

- Aufbau einer Staging-Umgebung

- Teamübergreifende Integration

- Gesund bleiben

- "Eine Geschichte über die Häufige Integration" von Lasse Koskela

Kapitel 7: Testfälle schreiben, von A bis Z

- Aufbau von Testfällen

- Benennung von Testfällen

- Buchführung auf dem Notizblock

- Der erste Testfall

- Der nächste Testfall

- Erinnerungstests

- Ergebnisse im Test festschreiben, nicht berechnen

- Erst die Zusicherung schreiben

- Features testen, nicht Methoden

- Finden von Testfällen

- Generierung von Testdaten

- Implementierungsunabhängige Tests

- Kostspielige Setups

- Lange Assert-Ketten oder mehrere Testfälle?

- Lerntests

- Minimale Fixture!

- "Einfache Tests - einfaches Design" von Dierk König

- Negativtests

- Organisation von Testfällen

- Orthogonale Testfälle

- Parameterisierbare Testfälle

- Qualität der Testsuite

- Refactoring von Testcode

- Reihenfolgeunabhängigkeit der Tests

- Selbsterklärende Testfälle

- String-Parameter von Zusicherungen

- Szenarientests

- Testexemplare

- Testsprachen

- Umgang mit Defekten

- "Eine Frage der (Test-)Kultur" von Christian Junghans & Olaf Kock

- Umgang mit externem Code

- Was wird getestet? Was nicht?

- Zufälle und Zeitabhängigkeiten

- "Der zeitlose Weg des Testens" von Lasse Koskela

Kapitel 8: Isoliertes Testen, durch Stubs und Mocks

- Verflixte Abhängigkeiten!

- Was ist die Unit im Unit Test?

- Mikrointegrationstest versus strikter Unit Test

- Vertrauenswürdige Komponenten

- "Vertrauen - und Tests" von Bastiaan Harmsen

- Austauschbarkeit von Objekten

- Stub-Objekte

- Größere Unabhängigkeit

- Testen durch Indirektion

- Stub-Variationen

- Testen von Mittelsmännern

- Self-Shunt

- Testen von innen

- Möglichst frühzeitiger Fehlschlag

- Erwartungen entwickeln

- Gebrauchsfertige Erwartungsklassen

- Testen von Protokollen

- Mock-Objekte

- Wann verwende ich welches Testmuster?

- "Wo Mock-Objekte herkommen" von Tim Mackinnon & Ivan Moore & Steve Freeman

- Crashtest-Dummies

- Dynamische Mocks mit EasyMock

- Stubs via Record/Replay

- Überspezifizierte Tests

- Überstrapazierte Mocks

- Systemgrenzen im Test

- "Mock-Objekte machen glücklich" von Moritz Petersen

Kapitel 9: Entwicklung mit Mock-Objekten

- Tell, don't ask

- Von außen nach innen

- Wer verifiziert wen?

- Schnittstellen finden auf natürlichem Weg

- Komponierte Methoden

- Vom Mock lernen für die Implementierung

- Viele schmale Schnittstellen

- Kleine fokussierte Klassen

- Tell und Ask unterscheiden

- nereimmargorP sträwkcüR

- Schüchterner Code und das Gesetz von Demeter

- Fassaden und Mediatoren als Abstraktionsebene

- Rekonstruktion

- "Meister, ..." von Dierk König

Kapitel 10: Akzeptanztests mit FIT (Framework for Integrated Test)

- Von einer ausführbaren Spezifikation ...

- Download Now

- Schritt für Schritt für Schritt

- ... zum ausführbaren Anforderungsdokument

- Die drei Basis-Fixtures

- »ActionFixture«

- Richtung peilen, Fortschritt erzielen

- Fixture wachsen lassen, dann Struktur extrahieren

- Nichts als Fassade

- Die Fixture als zusätzlicher Klient

- Aktion: Neue Aktion

- »ColumnFixture«

- Fixture-Interkommunikation

- Negativbeispiele

- Transformation: Action -> Column

- »RowFixture«

- Einfacher Schlüssel

- Mehrfacher Schlüssel

- Abfragemethoden einspannen

- »Summary«

- "Warum drei Arten von Fixtures?" von Ward Cunningham

- »ExampleTests«

- »AllFiles«

- Setup- und Teardown-Fixtures

- Das FIT-Framework von innen

- »FileRunner«

- »Parse«

- »Fixture«

- Annotationsmöglichkeiten in Dokumenten

- »TypeAdapter«

- »ScientificDouble«

- Domänenspezifische Grammatiken

- »ArrayAdapter«

- »PrimitiveFixture«

- Domänenspezifische Fixtures

- Anschluss finden

- Stichproben reiner Geschäftslogik

- Integrationstests gegen Fassaden und Services

- "Survival of the FIT Test" von Steffen Künzel & Tammo Freese

- Oberflächentests

- Kundenfreundliche Namen

- FitNesse

- FitLibrary

- Akzeptanztesten aus Projektsicht

Kapitel 11: Änderbare Software

- "Harte Prozesse führen zu harten Produkten" von Dierk König

- Konstantes Entwicklungstempo

- "Alten Code testgetrieben weiterentwickeln" von Juan Altmayer Pizzorno & Robert Wenner

- "Die Latte liegt jetzt höher" von Michael Feathers

- Kurze Zykluszeiten

- Neue Geschäftsmodelle

- "Bug-Trap-Linien" von Michael Hill

Behandelte Werkzeuge

Quellcode

Die Beispiele aus den Kapiteln 2, 3, 4, 5, 6, 7, 8 können Sie sich auch hier herunterladen.

Buch zum Download

JUnit 4.0

Eine kleine Sneak-Preview auf das neue JUnit, das im Sommer/Herbst erscheinen wird ... (im Vergleich zu JUnit 3.8.1)

Mit JUnit 4 haben Kent Beck und Erich Gamma nach mittlerweile sieben Jahren zum ersten Mal die Architektur ihres Test-Frameworks grundlegend geändert und alle Story-Karten auf die mit Java 1.5 eingeführten Annotationen gesetzt. Annotationen sind ein neues Ausdrucksmittel der im Trend liegenden Metaprogrammierung. Mithilfe von Annotationen können Sie Ihren Code mit frei wählbaren Anmerkungen versehen und auf die so markierten Codeelemente über den Reflection-Mechanismus später wieder zugreifen. In JUnit 4 wird dieses Sprachkonstrukt nun dazu verwendet, jede x-beliebige Methode jeder x-beliebigen Klasse als ausführbaren Testfall kennzeichnen zu können. Hier ist ein Test der neuen Schule:

import junit.framework.TestCase;

import org.junit.Test;

import static org.junit.Assert.*;

public class EuroTest extends TestCase {

@Test public void testadding() {

Euro two = new Euro(2.00);

Euro sum = two.add(two);

assertEquals("sum", new Euro(4.00), sum);

assertEquals("two", new Euro(2.00), two);

}

}

Sie erkennen, dass die Namenskonvention public void test...() wie auch das Ableiten der Klasse TestCase der Vergangenheit angehören.

Sie kleben künftig einfach eine @Test Annotation an Ihre Testfälle und können Ihre Methoden nennen, wie Ihnen gerade gefällt.

Doch gehen wir die Neuigkeiten doch einmal mit dem Vergrößerungsglas durch ...

Mit JUnit 4 kommt ein neuer Namensraum: Im Package org.junit steckt der neue annotationsbasierte Code.

Das junit.framework Paket bleibt soweit bestehen und hat lediglich kleine Änderungen erfahren, um die Aufwärtskompatibilität herzustellen.

Für Tests, die der neuen Schule folgen, benötigen wir von dem alten Zeugs jedoch nichts mehr:

import junit.framework.TestCase;

Stattdessen importieren wir jetzt die @Test Annotation und Methoden der Assert Klasse aus dem neuen JUnit-Package:

import org.junit.Test;

import static org.junit.Assert.*;

Falls Sie mit den neuen Sprachkonstrukten noch nicht vertraut sind: Ab Java 1.5 können Sie mithilfe von statischen Imports die statischen Methoden einer anderen Klasse einfach in den Namensraum Ihrer eigenen Klasse einblenden. Mit der Zeile:

import static org.junit.Assert.assertEquals;

... könnten wir beispielsweise die assertEquals Methode importieren, so als wäre diese eigentlich bei uns definiert.

Der oben verwendete Joker holt einfach alle statischen Methoden auf einen Schwung.

Als Nächstes ist augenfällig, dass unsere Klasse nicht mehr von der Klasse TestCase abgeleitet ist.

Ab sofort können Sie Ihre Tests nämlich in jede beliebige Klasse stecken.

Die einzige Bedingung ist: Ihre Klasse muss über einen öffentlichen Default-Konstruktor instanzierbar sein:

public class EuroTest extends TestCase {

Welche Methoden als Testfälle auszuführen sind, markieren wir jetzt mithilfe der @Test Annotation.

Den Klammeraffen nicht vergessen!

Welche Namen Sie Ihren Methoden geben, ist egal.

Den test... Präfix können Sie als Zeichen alter Tradition oder aus guter Konvention beibehalten oder es auch lassen.

Einzige Bedingung: Ihre Methode muss öffentlich sein, darf keine Parameter und keinen Rückgabewert haben:

@Test public void testadding() {

Euro two = new Euro(2.00);

Euro sum = two.add(two);

assertEquals("sum", new Euro(4.00), sum);

assertEquals("two", new Euro(2.00), two);

}

}

Das ist, auf einer Seite zusammengefasst, was sich grob geändert hat.

JUnit 4 führt sechs unterschiedliche Annotationen ein:

-

@Testkennzeichnet Methoden als ausführbare Testfälle. -

@Beforeund@Aftermarkieren Setup- bzw. Teardown-Aufgaben, die für jeden Testfall wiederholt werden sollen. -

@BeforeClassund@AfterClassmarkieren Setup- bzw. Teardown-Aufgaben, die nur einmal pro Testklasse ausgeführt werden sollen. -

@Ignorekennzeichnet temporär nicht auszuführende Testfälle.

@Before und @After

Setup- und Teardown-Methoden werden wie Testfälle via Annotation gekennzeichnet:

-

@BeforeMethoden werden vor jedem Testfall ausgeführt, -

@AfterMethoden nach jedem Testfall.

Auch diese Methoden können beliebige Namen tragen, müssen nun aber öffentlich zugänglich sein, parameterlos und ohne Rückgabewert. Der Fixture-Aufbau erfolgt auf dem gewohnten Weg:

import org.junit.Before;

public class EuroTest {

private Euro two;

@Before public void setUp() {

two = new Euro(2.00);

}

@Test public void amount() {

assertEquals(2.00, two.getAmount(), 0.001);

}

@Test public void adding() {

Euro sum = two.add(two);

assertEquals("sum", new Euro(4.00), sum);

assertEquals("two", new Euro(2.00), two);

}

}

Neu ist, dass auch mehrere @Before und @After Methoden pro Klasse laufen können.

Eine bestimmte Ausführungsreihenfolge wird dabei jedoch nicht zugesagt.

Vererbte und nicht überschriebene Methoden werden in symmetrischer Weise geschachtelt gerufen:

-

@BeforeMethoden der Oberklasse vor denen der Unterklasse -

@AfterMethoden der Unterklasse vor denen der Oberklasse

@BeforeClass und @AfterClass

Für kostspieligere Test-Setups, die nicht für jeden einzelnen Testfall neu aufgebaut und danach gleich wieder abgerissen werden können, existieren zwei weitere Annotationen:

-

@BeforeClassläuft für jede Testklasse nur ein einziges Mal und noch vor allen @Before Methoden, -

@AfterClassentsprechend für jede Testklasse nur einmal und zwar nach allen @After Methoden.

Mehrere @BeforeClass und @AfterClass Annotationen pro Klasse sind zugelassen.

Die so markierten Methoden müssen jedoch statisch sein:

import org.junit.BeforeClass;

import org.junit.AfterClass;

public class EuroTest...

@BeforeClass public static void veryExpensiveSetup() { ... }

@AfterClass public static void releaseAllResources() { ... }

}

Die @BeforeClass Methoden einer Oberklasse würden entsprechend noch vorher ausgeführt, alle ihre @AfterClass Methoden anschließend.

Erwartete Exceptions

Zum Testen von Exceptions können Sie der @Test Annotation über ihren optionalen Parameter expected mitteilen, dass die Ausführung Ihres Testfalls zu einer gezielten Exception führen soll:

public class EuroTest...

@Test(expected = IllegalArgumentException.class)

public void negativeAmount() {

final double NEGATIVE_AMOUNT = -2.00;

new Euro(NEGATIVE_AMOUNT); // should throw the exception

}

}

Wird keine Exception geworfen oder eine Exception anderen Typs, schlägt dieser Testfall eben genau fehl.

Wenn Sie das Exception-Objekt in dem Test noch weiter unter die Lupe nehmen wollen, um beispielsweise dessen Felder zu überprüfen, sollten Sie den altbekannten Weg über den try/catch Block nehmen.

Ansonsten ist diese Annotation sehr elegant.

Timeouts

Ein für Performanztests interessanter optionaler Parameter ist timeout.

Geben Sie Ihrem Testfall mit auf die Reise, in welcher Zeitspanne von Millisekunden er laufen sollte.

Überschreitet er darauf sein Zeitlimit, wird er zwecks Fehlschlags abgebrochen:

public class EuroTest...

@Test(timeout = 100)

public void performanceTest() { ... }

}

@Ignore

Wenn Sie einen Test kurzzeitig außer Gefecht setzen wollen, können Sie das tun:

import org.junit.Ignore;

public class EuroTest...

@Ignore("not today")

@Test(timeout = 100)

public void performanceTest() { ... }

}

Der @Ignore Kommentar darf, sollte aber niemals fehlen!

Der Test wird dann im Testlauf unter Protokollierung dieses Textes übergangen.

Sorgen Sie jedoch dafür, dass ignorierte Tests schnellstens auf grün kommen und im besten Fall gar nicht erst eingecheckt werden können!

Neue Tests mit altem Runner ausführen

Damit die existierenden und zum Teil in die Entwicklungsumgebungen direkt integrierten TestRunner unsere neuen Tests ausführen können, müssen wir einen kleinen Kunstgriff unternehmen:

import junit.framework.JUnit4TestAdapter;

public class EuroTest...

public static junit.framework.Test suite() {

return new JUnit4TestAdapter(EuroTest.class);

}

}

Etwas unschön, doch nur solange notwendig, bis unsere Werkzeuge die Brücke zur neuen annotationsbasierten Form geschlagen haben, muss die gute alte suite Methode uns als Adapterfunktion herhalten.

Nachtrag: Nach Artikel und Buch hinzugekommen sind die @RunWith und @Suite Annotationen:

-

Lasse Koskela

beschreibt, wie man Testsuiten mit JUnit 4 aufbaut,

beschreibt, wie man Testsuiten mit JUnit 4 aufbaut, -

Johannes Link

erklärt, wie man Testfälle mit seiner Eclipse-Erweiterung auch projektübergreifend ausführen kann.

erklärt, wie man Testfälle mit seiner Eclipse-Erweiterung auch projektübergreifend ausführen kann.

Alte Tests mit neuem Runner ausführen

JUnit 4 liefert nur noch einen textuellen Runner mit.

Die grafische Integration wird konsequent den Werkzeugherstellern überlassen.

Ebenso wandert die Organisation von Testfällen zu den Entwicklungswerkzeugen über.

Der neue Runner JUnitCore akzeptiert tatsächlich nur noch ein flaches Array von Testklassen:

import org.junit.runner.JUnitCore;

public class AllTests {

public static void main(String[] args) {

JUnitCore.run(CustomerTest.class,

EuroTest.class,

MovieTest.class);

}

}

Testfallerzeugung und Testlauf

Erwähnenswert ist noch, dass JUnit 4 nicht mehr in zwei Phasen läuft: Es werden also nicht erst alle Testfallobjekte auf Halde erzeugt und dann ausgeführt. Die Erzeugung erfolgt just-in-time zum Testlauf.

Schlüsselwort assert

Wenn Sie mögen, können Sie in Ihren Tests ab sofort auch das Java 1.4 Schlüsselwort assert verwenden.

Sie müssen lediglich daran denken, die Zusicherungen zur Laufzeit auch mit der Option -ea zu aktivieren.

JUnit ist dazu intern zur Verwendung von AssertionError gewechselt, was auch dazu geführt hat, dass nicht mehr zwischen möglichen und unerwarteten Fehlschlägen, Failures und Errors, unterschieden wird.

Fehler sind Fehler sind Fehler!

Subtile Unterschiede existieren zwischen altem und neuen Assert: junit.framework.Assert vs. org.junit.Assert.

Unter Java 1.5 sollten Sie nur noch die neue Klasse einsetzen.

Da Arrays untereinander nun auch über equals vergleichbar sind, werden Sie sogar mit einer neuen assert Methode beschenkt:

assertEquals(Object[] expected, Object[] actual)

Unit Tests mit JUnit

Automatisierte Unit Tests in Java

JUnit ist ein kleines, mächtiges Java-Framework zum Schreiben und Ausführen automatischer Unit Tests. Da die Tests direkt in Java programmiert werden, ist das Testen mit JUnit so einfach wie das Kompilieren. Die Testfälle sind selbstüberprüfend und damit wiederholbar.

Unit Testing ist der Test von Programmeinheiten in Isolation von anderen im Zusammenhang eines Programms benötigten, mitwirkenden Programmeinheiten. Die Größe der unabhängig getesteten Einheit kann dabei von einzelnen Methoden über Klassen bis hin zu Komponenten reichen.

Download und Installation

JUnit ist als Open Source Software unter der IBM Public License

veröffentlicht.

Die aktuelle Version (momentan JUnit 3.8) können Sie von SourceForge

beziehen:

https://sourceforge.net/projects/junit/.

Entsprechende Frameworks sind für nahezu alle gängigen

Programmiersprachen frei erhältlich:

http://www.xprogramming.com/software.htm![]() .

.

Das JUnit-Framework kommt in einem JAR-Archiv namens junit.jar

verpackt.

Die vollständige Distribution besteht gegenwärtig aus einem

ZIP-Archiv, in dem neben junit.jar auch dessen Quelltexte,

dessen Tests, einige Beispiele, die JavaDoc-Dokumentation, die FAQ,

ein Kochbuch und zwei sehr lesenswerte Artikel aus dem amerikanischen

Java Report beiliegen.

Machen Sie sich mal ruhig mit den Beigaben vertraut.

Es lohnt sich.

Zur Installation entpacken Sie bitte das ZIP-Archiv und übernehmen

Sie junit.jar in Ihren CLASSPATH.

Fertig!

Wie Sie JUnit mit praktisch jeder gängigen Java-Entwicklungsumgebung

verwenden, können Sie unter

http://www.junit.org/IDEs.htm![]() nachlesen.

Für den Anfang reicht es jedoch vollkommen aus, wenn Ihr Compiler sich

nicht darüber beschwert, die JUnit-Klassen in seinem Klassenpfad zu

vermissen.

Den Test dafür werden wir in zwei Minuten machen.

nachlesen.

Für den Anfang reicht es jedoch vollkommen aus, wenn Ihr Compiler sich

nicht darüber beschwert, die JUnit-Klassen in seinem Klassenpfad zu

vermissen.

Den Test dafür werden wir in zwei Minuten machen.

Ein erstes Beispiel

Wir wollen eine Klasse Euro ins Leben testen,

die Euro-Beträge akurater repräsentieren kann als der

bloße Java-Typ double, den wir bisher

(im Artikel "XP über die Schulter geschaut")

verwendet haben.

Anhand dieses kleinen Beispiels können Sie den prinzipiellen Aufbau

eines Testfalls kennenlernen und Ihren ersten kleinen Erfolg mit JUnit

feiern.

In der JUnit-Dokumentation werden Sie ein ähnliches Beispiel finden.

Ich habe mich aus verschiedenen Gründen dafür entschieden,

auf vertrautem Terrain loszuwandern.

Michael Wein schrieb mir, unbedingt darauf hinzuweisen, daß weder

die Money Klasse der JUnit-Distribution noch die in diesem

Beispiel entwickelte Klasse den Robustheitsanforderungen der

Finanzwirtschaft genügt.

Wenn's drauf ankommt, benutzen Sie besser java.lang.BigDecimal

oder ähnliches.

Die Klasse Euro stellt Wertobjekte für geldliche

Beträge dar.

Das heißt, das Objekt wird eindeutig durch seinen Wert beschrieben.

Sie können ein Wertobjekt nicht verändern.

Wenn Sie ein Wertobjekt manipulieren, erhalten Sie ein anderes Objekt

mit dem neuen Wert zurück.

Einen Test für eine Klasse zu schreiben bietet immer auch eine gute

Gelegenheit, über ihre öffentliche Schnittstelle nachzudenken.

Was also erwarten wir von unserer Klasse?

Nun, zunächst möchten wir sicherlich ein Euro Objekt

instanzieren können, indem wir dem Konstruktor einen Geldbetrag

übergeben.

Wenn wir ein Euro Objekt zu einem anderen hinzuaddieren,

möchten wir, daß unsere Klasse mit einem neuen Euro

Objekt antwortet, das die Summe der beiden Beträge enthält.

Euro-Beträge unterliegen dabei einer besonderen Auflösung

in ihrer numerischen Repräsentation.

Zum Beispiel erwarten wir, daß auf den Cent genau gerundet wird und

daß 100 Cents einen Euro ergeben.

Aber fangen wir mit der einfachen Datenhaltung an.

Hier sehen Sie den ersten Test:

import junit.framework.*;

public class EuroTest extends TestCase {

public EuroTest(String name) {

super(name);

}

public void testAmount() {

Euro two = new Euro(2.00);

assertTrue(2.00 == two.getAmount());

}

public static void main(String[] args) {

junit.swingui.TestRunner.run(EuroTest.class);

}

}

JUnit ist wirklich einfach zu verwenden. Es wird nicht schwerer.

Anatomie eines Testfalls

Sie erkennen, daß wir unsere Tests getrennt von der Klasse

Euro in einer Klasse namens EuroTest definieren.

Um unsere Testklasse in JUnit einzubinden, leiten wir sie von dessen

Framework-Basisklasse junit.framework.TestCase ab.

Jede Testklasse erhält einen Konstruktor für den Namen des auszuführenden Testfalls. Das Test-Framework instanziert für jeden Testfall ein neues Exemplar dieser Klasse, wie wir später bei der Betrachtung des Lebenszyklus eines Testfalls sehen werden.

Unser erster Testfall verbirgt sich hinter der Methode

testAmount.

JUnit erkennt diese Methode dadurch als Testfall, daß sie der

Konvention des Signaturmusters public void test...() folgt.

Testfallmethoden dieses Musters kann das Framework via Java Reflection

zu einer Suite von Tests zusammenfassen und voneinander isoliert

ausführen.

In diesem Testfall erzeugen wir uns zunächst ein Objekt mit dem

Wert "zwei Euro".

Der eigentliche Test erfolgt mit dem Aufruf der assertTrue

Methode, die unsere Testklasse aus ihrer Oberklasse erbt.

Das assertTrue Statement formuliert eine Annahme,

die JUnit automatisch für uns verifizieren wird.

Die assertTrue Methode dient dazu, eine Bedingung zu testen.

Als Argument akzeptiert sie einen boolschen Wert bzw. einen Ausdruck,

der einen solchen liefert.

Der Test ist erfolgreich, wenn die Bedingung erfüllt ist,

d.h. der Ausdruck zu true ausgewertet werden konnte.

Ist die Bedingung nicht erfüllt, d.h. false,

protokolliert JUnit einen Testfehler.

In diesem Beispiel testen wir, daß unser Objekt two

als Ergebnis der getAmount Operation die erwarteten

"zwei Euro" antwortet.

Durch Aufruf der main Methode können wir unseren ersten

JUnit-Test ausführen.

Der junit.swingui.TestRunner stellt eine grafische

Oberfläche auf Basis von Java Swing dar, um Unit Tests kontrolliert

ablaufen zu lassen.

Mit der JUnit-Oberfläche werden wir uns noch zu einem späteren

Zeitpunkt beschäftigen.

Momentan läßt sich unsere Testklasse noch nicht übersetzen.

Sie beschwert sich noch darüber, keine Klasse Euro

zu kennen.

Erst testen, dann programmieren

Im nächsten Artikel werden wir der Programmiertechnik Testgetriebene Entwicklung begegnen. Dort werden Sie sehen, wie wir ein Programm inkrementell in kleinen Schritten entwickeln können, indem wir grundsätzlich immer zuerst einen Test schreiben, bevor wir die Klasse weiter schreiben, die diesen Test dann erfüllt. Natürlich können Sie mit JUnit aber auch Tests für schon bestehenden Code schreiben, obwohl Klassen oft schlecht testbar sind, wenn sie nicht von vornherein mit Testbarkeit im Hinterköpfchen entworfen wurden.

-

- Schreiben Sie Tests, bevor Sie den Code schreiben, der diese Tests erfüllen soll, damit Sie sicherstellen, daß Ihr Code einfach zu testen ist.

Den Prozess der testgetriebenen Programmierung werden Sie später

noch detailliert kennenlernen.

Zu diesem Zeitpunkt wollen wir uns allein auf das Testen mit JUnit

konzentrieren.

Lassen Sie uns deshalb direkt zur Implementation der Klasse

Euro übergehen.

Was müssen wir hinschreiben, um den Test zu erfüllen?

public class Euro {

private double amount;

public Euro(double amount) {

this.amount = amount;

}

public double getAmount() {

return this.amount;

}

}

public class Euro {

private double amount;

public Euro(double amount) {

this.amount = amount;

}

public double getAmount() {

return this.amount;

}

}

Wenn Sie den Code kompilieren und EuroTest ausführen

(entweder aus Ihrer IDE heraus oder via java EuroTest auf

der Kommandozeile), sollte ein neues Fensterchen mit JUnit's grafischer

Oberfläche und darin ein freundlicher, hellgrüner Balken erscheinen.

Erfolg!

Der Test läuft.

Klicken Sie ruhig noch einmal auf den Run Knopf.

Dieser Knopf macht ganz klar süchtig.

Sie werden sich später ganz sicher dabei ertappen, die Tests zwei- oder

dreimal nacheinander auszuführen nur wegen des zusätzlichen

Vertrauens, das Ihnen der grüne Balken schenkt.

Es ist wirklich ein unbeschreiblich großartiges Gefühl, wenn

hunderte von Tests ablaufen und sich der Fortschrittbalken dabei von links

nach rechts mit Grün füllt.

So ein Gefühl gibt Mut, die "Softness" von Software auf's

Neue zu entdecken.

Das JUnit-Framework

Im zweiten Teil des Artikels möchte ich Ihnen den Aufbau von JUnit detaillierter vorstellen. Ich könnte Ihnen empfehlen, sich den Code von JUnit genau anzusehen. Wenn Sie so sind wie ich, dann lernen Sie ein Framework am besten, indem Sie dessen Code studieren. JUnit ist ein gutes Beispiel für ein kleines, fokussiertes Framework mit einer hohen Dichte säuberlich verwendeter Entwurfsmuster. JUnit ist vor allem deshalb ein gutes Beispiel, weil es inklusive seines eigenen Testcode kommt. Versprechen Sie sich selbst bitte, daß Sie den Code lesen werden. Wenigstens irgendwann...

-

-

Eines guten Tages sollten Sie sich die Zeit nehmen und den

junit.frameworkCode studieren und um Ihre eigenen Anforderungen erweitern.

Ich werde im folgenden die JUnit-Klassen vorstellen, mit denen Sie am

meisten in Berührung kommen werden.

Wenn Sie keine Mühe gescheut haben und sich tatsächlich angeschaut

haben, was Kent Beck und Erich Gamma ursprünglich auf einem Flug zur

OOPSLA-Konferenz zusammen programmiert haben, wissen Sie schon, wovon ich

sprechen werde.

Was Sie wahrscheinlich jedoch noch nicht wissen ist, wie die einzelnen

Puzzlestücke zum Ganzen zusammengelegt werden.

Dazu wenden wir uns hin und wieder unserer Euro Klasse zu.

"Assert"

Wie testen wir mit JUnit?

JUnit erlaubt uns, Werte und Bedingungen zu testen,

die jeweils erfüllt sein müssen, damit der Test okay ist.

Die Klasse Assert definiert dazu eine Menge von

assert Methoden, die unsere Testklassen aus JUnit erben

und mit denen wir in unseren Testfällen eine Reihe unterschiedlicher

Behauptungen über den zu testenden Code aufstellen können:

-

assertTrue(boolean condition)verifiziert, ob eine Bedingung wahr ist. - Beispiele:

assertTrue(theJungleBook.isChildrensMovie()); assertTrue(40 == xpProgrammer.workingHours() * days);-

assertEquals(Object expected, Object actual)verifiziert, ob zwei Objekte gleich sind. Der Vergleich der Objekte erfolgt in JUnit über dieequalsMethode. - Beispiele:

assertEquals("foobar", "foo" + "bar"); assertEquals(new Euro(2), Movie.getCharge(1));

Der Vorteil dieser und der folgenden assertEquals Varianten

gegenüber dem Test mit assertTrue liegt darin,

daß JUnit Ihnen nützliche zusätzliche Informationen bieten

kann, wenn der Test tatsächlich fehlschlägt.

JUnit benutzt in diesem Fall die toString Repräsentation

Ihres Objekts, um den erwarteten Wert auszugeben.

-

assertEquals(int expected, int actual)verifiziert, ob zwei ganze Zahlen gleich sind. Der Vergleich erfolgt für die primitiven Java-Typen über den==Operator. - Beispiele:

assertEquals(9, customer.getFrequentRenterPoints()); assertEquals(40, xpProgrammer.workingHours() * days);-

assertEquals(double expected, double actual, double delta)verifiziert, ob zwei Fließkommazahlen gleich sind. Da Fließkommazahlen nicht mit unendlicher Genauigkeit verglichen werden können, wird zusätzlich eine Toleranz erwartet. - Beispiele:

assertEquals(3.1415, Math.pi(), 1e-4);-

assertNull(Object object)verifiziert, ob eine Objektreferenznullist. - Beispiele:

assertNull(hashMap.get(key));-

assertNotNull(Object object)verifiziert, ob eine Objektreferenz nichtnullist. - Beispiele:

assertNotNull(httpRequest.getParameter("action"));-

assertSame(Object expected, Object actual)verifiziert, ob zwei Referenzen auf das gleiche Objekt verweisen. - Beispiele:

assertSame(bar, hashMap.put("foo", bar).get("foo"));

Die assertEquals Methode ist neben den oben aufgeführten

Argumenttypen auch für die primitiven Datentypen float,

long, boolean, byte, char

und short überladen.

Der Phantasie beim Testen sind also keine Grenzen gesetzt.

"AssertionFailedError"

Was passiert, wenn ein Test fehlschlägt?

Die im Testcode durch assert Anweisungen

kodierten Behauptungen werden von der Klasse Assert

automatisch verifiziert.

Im Fehlerfall bricht JUnit den laufenden Testfall sofort mit dem Fehler

AssertionFailedError ab.

Um den Test des centweisen Rundens nachzuholen, könnten wir zum Beispiel folgenden Testfall schreiben:

public class EuroTest...

public void testRounding() {

Euro roundedTwo = new Euro(1.995);

assertTrue(2.00 == roundedTwo.getAmount());

}

}

Der Test läuft natürlich nicht, weil unsere Klasse noch kein Konzept für das Runden hat. Der Fortschrittbalken verfärbt sich rot.

Die Oberfläche teilt uns mit, daß während der Ausführung unseres neuen Testfalls ein Fehler (Failure) aufgetreten ist, der im unteren Textfenster zur Rückmeldung protokolliert wird:

junit.framework.AssertionFailedError

at EuroTest.testRounding(EuroTest.java:16)

junit.framework.AssertionFailedError

at EuroTest.testRounding(EuroTest.java:16)

"Der Testfall testRounding schlug fehl",

sagt uns JUnit.

"Werfen Sie einen Blick auf Zeile 16 der Klasse

EuroTest."

Wenn Ihnen diese Fehlermeldung nicht ausreichen sollte, bietet Ihnen JUnit

für alle assert Methoden an, einen Erklärungstext

zu tippen, der im Fehlerfall mitprotokolliert wird.

Ich kann Ihnen nur raten, diese Variante zur Dokumentation der Tests

auszunutzen, ganz besonders bei langen Ketten von assert

Anweisungen.

assertTrue("amount not rounded", 2.00 == roundedTwo.getAmount());

-

- Für die Tests gilt der gleiche Qualitätsanspruch wie für den übrigen Code: selbstdokumentierend, kein duplizierter Code und möglichst einfach.

Der Unterschied liegt allein im ausdrucksstärkeren Begleittext, den JUnit im Fehlerfall zusätzlich ausgibt statt nur dem Namen des fehlgeschlagenen Testfalls und der Zeilennummer des aufgetretenen Fehlers:

junit.framework.AssertionFailedError:

amount not rounded

at EuroTest.testRounding(EuroTest.java:16)

junit.framework.AssertionFailedError:

amount not rounded

at EuroTest.testRounding(EuroTest.java:16)

Das Beste wäre in diesem Fall natürlich gewesen, wir hätten

gleich die bequemere assertEquals Variante verwendet:

assertEquals("rounded amount",

2.00, roundedTwo.getAmount(), 0.001);

In diesem Fall kann JUnit den erwarteten gegen den tatsächlichen Wert testen und unser Begleittext darf etwas kürzer ausfallen:

junit.framework.AssertionFailedError:

rounded amount expected:<2.0> but was:<1.995>

at EuroTest.testRounding(EuroTest.java:16)

junit.framework.AssertionFailedError:

rounded amount expected:<2.0> but was:<1.995>

at EuroTest.testRounding(EuroTest.java:16)

Zum Vergleich der intern verwendeten Fließkomma-Repräsentation

tolerieren wir in diesem Beispiel ein Delta von 0.001.

Das bedeutet, daß die verglichenen Werte sich nicht um einen

Betrag unterscheiden dürfen, der grösser ist als ein

Tausendstel Euro.

Mittlerweile finde ich den Anblick des roten Fortschrittbalkens aber schon etwas unbefriedigend, Sie nicht auch? Vom Testen infiziert zu sein bedeutet, nicht eher locker zu lassen, bis die Tests wieder auf grün sind. Die Frage ist: Wollen Sie den Konstruktor selbst anpassen oder wollen Sie sehen, was ich hingetippt hätte? Voilà!

public class Euro {

private long cents;

public Euro(double euro) {

cents = Math.round(euro * 100.0);

}

public double getAmount() {

return cents / 100.0;

}

}

public class Euro {

private long cents;

public Euro(double euro) {

cents = Math.round(euro * 100.0);

}

public double getAmount() {

return cents / 100.0;

}

}

"TestCase"

Wie gruppieren wir Testfälle um eine gemeinsame Menge von Testobjekten?

Ein Testfall sieht in der Regel so aus, daß eine bestimmte Konfiguration von Objekten aufgebaut wird, gegen die der Test läuft. Diese Menge von Testobjekten wird auch als Test-Fixture bezeichnet. Pro Testfallmethode wird meist nur eine bestimmte Operation und oft sogar nur eine bestimmte Situation im Verhalten der Fixture getestet.

-

- Testen Sie pro Testfallmethode nicht zuviel, nur eine ganz bestimmte Funktion und dabei immer nur eine interessante Randbedingung zurzeit.

Schauen wir uns dazu ein Beispiel an:

public class EuroTest...

public void testAdding() {

Euro two = new Euro(2.00);

Euro three = two.add(new Euro(1.00));

assertEquals("sum", 3.00, three.getAmount(), 0.001);

assertEquals("two", 2.00, two.getAmount(), 0.001);

}

}

In diesem Testfall erzeugen wir uns ein Euro Objekt und

addieren es zu einem anderen.

Das Resultat der Addition soll ein neues Euro Objekt sein,

dessen Wert die Summe von "einem Euro" und "zwei Euro",

also "drei Euro" beträgt.

Unser ursprüngliches "zwei Euro" Objekt soll durch die

Addition nicht verändert werden.

Wenn wir diesen Test erfüllen sollten, würden wir vielleicht

folgendes programmieren:

public class Euro...

private Euro(long cents) {

this.cents = cents;

}

public Euro add(Euro other) {

return new Euro(this.cents + other.cents);

}

}

public class Euro...

private Euro(long cents) {

this.cents = cents;

}

public Euro add(Euro other) {

return new Euro(this.cents + other.cents);

}

}

Der JUnit-Balken ist wieder zurück auf grün, aber was passiert

eigentlich, wenn wir ein Euro Objekt mit negativem Betrag

definieren würden und damit die add Operation aufriefen?

Wäre damit noch die Intention des Addierens ausgedrückt oder

sollte es dann besser subtract heissen?

Verschieben wir die Antwort auf diese Frage für ein paar Momente.

Damit wir die Idee aber nicht verlieren, notieren wir auf einer Karteikarte

"Wie geht add mit negativen Beträgen um?"

-

- Halten Sie Ideen sofort fest, verlieren Sie sie nicht wieder.

Wir waren dabei stehengeblieben, eine geeignete Test-Fixture herauszuziehen.

Lassen Sie uns dazu noch einmal einen kurzen Blick auf unsere bisherige

EuroTest Klasse werfen:

import junit.framework.*;

public class EuroTest extends TestCase {

public EuroTest(String name) {

super(name);

}

public void testAmount() {

Euro two = new Euro(2.00);

assertTrue(2.00 == two.getAmount());

}

public void testRounding() {

Euro roundedTwo = new Euro(1.995);

assertEquals("rounded amount",

2.00, roundedTwo.getAmount(), 0.001);

}

public void testAdding() {

Euro two = new Euro(2.00);

Euro three = two.add(new Euro(1.00));

assertEquals("sum", 3.00, three.getAmount(), 0.001);

assertEquals("two", 2.00, two.getAmount(), 0.001);

}

public static void main(String[] args) {

junit.swingui.TestRunner.run(EuroTest.class);

}

}

Da sich der Code zum Aufbau einer bestimmten Testumgebung häufig wiederholt, sollten Sie alle Testfälle, die gegen die gleiche Menge von Testobjekten laufen, unter dem Dach einer Testklasse zusammenfassen. Mit dem Code, der in den Testfällen jeweils das "zwei Euro" Objekt kreiert, haben wir duplizierten Code dieser Art, den wir nun in die Fixture herausziehen wollen. Der Gewinn wird aus diesem ersten Beispiel nicht unmittelbar deutlich werden. Später werden wir Testklassen mit komplexeren Testumgebungen begegnen, in denen die Testfälle durch diesen Schritt stark vereinfacht werden können.

Allgemein gilt, daß alle Testfälle einer Testklasse von der gemeinsamen Fixture Gebrauch machen sollten. Hat eine Testfallmethode keine Verwendung für die Fixture-Objekte, so ist dies meist ein guter Indiz dafür, daß die Methode auf eine andere Testklasse verschoben werden will. Generell sollten Testklassen um die Fixture organisiert werden, nicht um die getestete Klasse. Somit kann es durchaus vorkommen, daß zu einer Klasse mehrere korrespondierende Testklassen existieren, von denen jede ihre individuelle Test-Fixture besitzt.

-

- Organisieren Sie Testklassen um eine gemeinsame Fixture von Testobjekten, nicht um die getestete Klasse.

Schauen wir uns unseren Testcode unter diesen Gesichtspunkten an. Im ersten und dritten Testfall verwenden wir das "zwei Euro" Objekt. Wir könnten damit anfangen, dieses Objekt in die Test-Fixture zu übernehmen. Der zweite Testfall macht eine Ausnahme. Lassen Sie uns auch hier später entscheiden, wie wir damit umgehen möchten. Wir nehmen also eine weitere Karteikarte, notieren einfach "EuroTest testRounding() refaktorisieren" und setzen uns auf die Karte drauf.

Damit fehlerhafte Testfälle nicht andere Testfälle beeinflussen

können, wird die Test-Fixture für jeden Testfall neu initialisiert.

Dazu müssen Sie die Objekte der Test-Fixture zu Instanzvariablen Ihrer

TestCase Unterklasse erklären.

Sie haben dann die Möglichkeit, zwei Einschubmethoden des Frameworks

wie folgt zu überschreiben:

In der Methode setUp initialisieren Sie diese Instanzvariablen,

um so eine definierte Testumgebung zu schaffen.

In der Methode tearDown geben Sie wertvolle Testressourcen

wie zum Beispiel Datenbank- oder Netzwerkverbindungen wieder frei, die Sie

zuvor in setUp in Anspruch genommen haben.

JUnit behandelt Ihre Test-Fixture dann wie folgt:

Die setUp Methode wird gerufen, bevor ein Testfall

ausgeführt wird.

Die tearDown Methode wird gerufen, nachdem ein Testfall

ausgeführt wurde.

Hier sehen Sie unsere Testklasse mit extrahierter Test-Fixture:

import junit.framework.*;

public class EuroTest extends TestCase {

private Euro two;

public EuroTest(String name) {

super(name);

}

protected void setUp() {

two = new Euro(2.00);

}

protected void tearDown() {

}

public void testAmount() {

assertTrue(2.00 == two.getAmount());

}

public void testRounding() {

Euro roundedTwo = new Euro(1.995);

assertEquals("rounded amount",

2.00, roundedTwo.getAmount(), 0.001);

}

public void testAdding() {

Euro three = two.add(new Euro(1.00));

assertEquals("sum", 3.00, three.getAmount(), 0.001);

assertEquals("two", 2.00, two.getAmount(), 0.001);

}

public static void main(String[] args) {

junit.swingui.TestRunner.run(EuroTest.class);

}

}

import junit.framework.*;

public class EuroTest extends TestCase {

private Euro two;

public EuroTest(String name) {

super(name);

}

protected void setUp() {

two = new Euro(2.00);

}

protected void tearDown() {

}

public void testAmount() {

assertTrue(2.00 == two.getAmount());

}

public void testRounding() {

Euro roundedTwo = new Euro(1.995);

assertEquals("rounded amount",

2.00, roundedTwo.getAmount(), 0.001);

}

public void testAdding() {

Euro three = two.add(new Euro(1.00));

assertEquals("sum", 3.00, three.getAmount(), 0.001);

assertEquals("two", 2.00, two.getAmount(), 0.001);

}

public static void main(String[] args) {

junit.swingui.TestRunner.run(EuroTest.class);

}

}

Bitte beachten Sie, daß Sie Fixture-Variablen in der setUp

Phase initialisieren, nicht im Deklarationsteil noch im Konstruktor der

Testfallklasse.

Bitte beachten Sie ferner, daß wir die tearDown Methode

in diesem Fall nicht hätten definieren müssen, da wir keine

Testressourcen freizugeben haben.

Ich habe sie hier lediglich aus Gründen der Vollständigkeit stehen

gelassen und damit Sie ihr schon einmal begegnet sind.

Lebenszyklus eines Testfalls

Was passiert, wenn JUnit die Tests dieser Klasse ausführt?

-

Das Test-Framework durchsucht die Testklasse mit Hilfe des Reflection API

nach öffentlichen Methoden, die mit

testbeginnen und weder Parameter noch Rückgabewert besitzen. - JUnit sammelt diese Testfallmethoden in einer Testsuite und führt sie voneinander isoliert aus. Die Reihenfolge, in der Testfallmethoden vom Framework gerufen werden, ist dabei prinzipiell undefiniert.

- Damit zwischen einzelnen Testläufen keine Seiteneffekte entstehen, erzeugt JUnit für jeden Testfall ein neues Exemplar der Testklasse und damit eine frische Test-Fixture.

-

Der Lebenszyklus dieses Exemplars ist so gestaltet, daß vor der

Ausführung eines Testfalls jeweils die

setUpMethode aufgerufen wird, sofern diese in der Unterklasse redefiniert wurde. -

Anschliessend wird eine der

test...Methoden ausgeführt. -

Nach der Ausführung des Testfalls ruft das Framework die

tearDownMethode, falls diese redefiniert wurde, und überläßt dasEuroTestObjekt dann der Speicherbereinigung. - Dieser Zyklus wird vereinfacht erklärt ab Schritt 3 solange wiederholt, bis alle Testfälle jeweils einmal ausgeführt wurden.

Wenn wir die Sequenz mit einem Profiler aufzeichnen würden, in der JUnit unsere Testklasse benutzt, ergibt sich hier beispielsweise folgende Aufrufreihenfolge:

new EuroTest("testAdding")setUp()testAdding()tearDown()new EuroTest("testAmount")setUp()testAmount()tearDown()new EuroTest("testRounding")setUp()testRounding()tearDown()

-

- Zum effektiven Testen müssen Testfälle isoliert voneinander ausführbar sein. Treffen Sie deshalb keine Annahmen über die Reihenfolge, in der Testfälle ausgeführt werden. Führen Sie voneinander abhängige Tests stattdessen gemeinsam in einem Testfall aus.

Wir sind jetzt an einer Stelle angelangt, an der es lohnen könnte, das grössere Bild zu betrachten. In UML läßt sich der Sachverhalt in etwa wie folgt darstellen:

- Assert

- testet Werte und Bedingungen

- TestCase

- isoliert eine Reihe von Testfällen um eine gemeinsame Fixture von Testobjekten

- EuroTest

- testet das Verhalten unserer entwickelten

EuroKlasse

(Mit dem Wechsel von der D-Mark zum Euro wurde auch unsere Klasse umgetauft. Das Diagramm zeigt noch den alten Namen, sorry.)

"TestSuite"

Wie führen wir eine Reihe von Tests zusammen aus?

Unser Ziel ist es, den gesamten Testprozess so weit zu automatisieren, daß wir den Test ohne manuellen Eingriff wiederholbar durchführen können. Wichtig ist schließlich, die Unit Tests möglichst häufig auszuführen, idealerweise nach jedem Kompilieren . Nur so erhalten wir unmittelbares Feedback darüber, wann unser Code zu funktionieren beginnt und wann er zu funktionieren aufhört. Wenn wir also immer nur winzig kleine Bissen vom Problemkuchen nehmen, werden wir uns nie länger als 1-3 Minuten mit Programmieren aufhalten, ohne grünes Licht zum Weiterprogrammieren einzuholen. Eher selten werden wir dabei nur einzelne Tests ausführen wollen. Meistens ist es schlau, alle gesammelten Unit Tests in einem Testlauf auszuführen, um ungewollten Seiteneffekten frühzeitig zu begegnen.

-

- Führen Sie möglichst nach jedem erfolgreichen Kompiliervorgang alle gesammelten Unit Tests aus.

Mit JUnit können wir beliebig viele Tests in einer Testsuite

zusammenfassen und gemeinsam ausführen.

Dazu verlangt JUnit von uns, daß wir in einer statischen

suite Methode definieren, welche Tests zusammen ausgeführt

werden sollen.

Eine Suite von Tests wird dabei durch ein TestSuite Objekt

definiert, dem wir beliebig viele Tests und selbst andere Testsuiten

hinzufügen können.

Auf welcher Klasse Sie diese suite Methode definieren ist

nebensächlich.

In den meisten Fällen werden Sie jedoch spezielle Klassen allein

dafür definieren wollen, um solche Testsuiten zu repräsentieren.

Nehmen wir beispielsweise alle bisher bestehenden Testfälle (auch jene

aus dem "XP über die Schulter geschaut" Artikel), würde unsere Testsuiteklasse folgende

Gestalt annehmen:

import junit.framework.*;

public class AllTests {

public static Test suite() {

TestSuite suite = new TestSuite();

suite.addTestSuite(CustomerTest.class);

suite.addTestSuite(EuroTest.class);

suite.addTestSuite(MovieTest.class);

return suite;

}

}

Alles, was Sie in JUnit zu tun haben, um eine Testsuite zu definieren,

ist ein TestSuite Exemplar zu bilden und mittels der

addTestSuite Methode verschiedene Testfallklassen

hinzuzufügen.

Jede Testfallklasse definiert implizit eine eigene suite

Methode, in der alle Testfallmethoden eingebunden werden, die in der

betreffenden Klasse definiert wurden.

JUnit erledigt diesen Teil für Sie automatisch mittels Reflection.

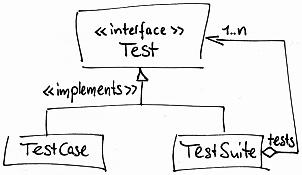

Sie werden vielleicht über den Typ des Rückgabewerts der

suite Methode verwundert sein.

Warum Test und nicht TestSuite?

Nun, hier begegnen wir erstmalig JUnit's Test Interface,

das sowohl von TestCase als auch von TestSuite

implementiert wird.

Dieses Entwurfsmuster ist auch als Kompositum (engl. Composite) bekannt.

Es erlaubt genau, daß wir beliebig viele TestCase und

TestSuite Objekte zu einer umfassenden Testsuite-Hierarchie

kombinieren können.

In UML ausgedrückt:

- Test

- abstrahiert von Testfällen und Testsuiten

- TestSuite

- führt eine Reihe von Tests zusammen aus

Momentan liegen alle unsere Klassen noch im Default-Package. Der Regelfall ist natürlich, daß unsere Klassen in verschiedenen Paketen stecken. Wir werden die Klassen später auf geeignete Klassenpakete verteilen. In einem solchen Fall müssen wir das Klassenpaket beim Bündeln der Testsuite entweder mitspezifizieren oder importieren:

suite.addTestSuite(common.Contract.class);

In vielen Fällen ist es praktisch, pro Package eine Testsuiteklasse zu

definieren.

Schon seit JUnit 1.0 ist es geläufig, Testsuiteklassen mit dem

Namen AllTests zu benennen.

Nach diesem Muster können Sie Hierarchien von Hierarchien von Testsuiten

bilden:

suite.addTest(database.AllTests.suite());

Bitte beachten Sie, daß wir die main Methode von der

EuroTest Testfallklasse in die AllTests

Testsuiteklasse verschieben sollten, da sie hier besser aufgehoben ist:

public class AllTests...

public static void main(String[] args) {

junit.swingui.TestRunner.run(AllTests.class);

}

}

Wenn Sie die Testsuite aller Unit Tests ausführen möchten,

tippen Sie bitte java AllTests oder

führen die Klasse innerhalb Ihrer Java IDE aus.

In jedem Fall sollte sich die bekannte JUnit-Oberfläche auftun.

Abschließend...

Im dritten und letzten Teil dieses Artikels wollen wir auf die beiden Karteikarten zurückkommen, die wir im Zuge unserer Programmierepisode zurückgelassen haben.

Erinnern Sie sich noch an die Karte "EuroTest testRounding()

refaktorisieren"?

Wir hatten uns vorgenommen, uns den Testfall testRounding

noch einmal vorzuknöpfen, weil dieser Testfall vom

üblichen Testmuster der Test-Fixture abzuweichen schien.

Bedeutet das nun wirklich, wir müssten extra für diesen Testfall

eine neue Testfallklasse bilden?

Nein, wir können guten Gebrauch der Test-Fixture machen, wenn wir

unseren Testfall geeignet umschreiben:

public class EuroTest...

public void testRounding() {

Euro roundedTwo = new Euro(1.995);

assertEquals("rounded amount", two, roundedTwo);

}

}

Für ein richtiges Wertobjekt gehört es sich ohnehin, daß wir

zwei Objekte mittels der equals Methode auf Gleichheit testen

können.

Lassen Sie uns diese Intention deshalb auch in unserem Code ausdrücken:

public class EuroTest...

public void testAdding() {

Euro three = two.add(new Euro(1.00));

assertEquals("sum", new Euro(3.00), three);

assertEquals("two", new Euro(2.00), two);

}

}

Aber warten Sie! Unsere Tests fangen an, sich zu beschweren:

junit.framework.AssertionFailedError:

sum expected:<Euro@8b456289> but was:<Euro@8b496289>

at EuroTest.testAdding(EuroTest.java:30)

junit.framework.AssertionFailedError:

rounded amount expected:<Euro@18d18634> but was:<Euro@19318634>

at EuroTest.testRounding(EuroTest.java:24)

junit.framework.AssertionFailedError:

sum expected:<Euro@8b456289> but was:<Euro@8b496289>

at EuroTest.testAdding(EuroTest.java:30)

junit.framework.AssertionFailedError:

rounded amount expected:<Euro@18d18634> but was:<Euro@19318634>

at EuroTest.testRounding(EuroTest.java:24)

Das ist gut, daß uns JUnit sagt, daß was nicht stimmt!

Aber was geht hier vor?

Die Ausgabe der Objektreferenzen, die Java standardmässig als Resultat

der toString Methode liefert, hilft uns wenig weiter.

Überschreiben wir also mal das Standardverhalten mit einer

ausdrucksstärkeren String-Repräsentation:

public class Euro...

public String toString() {

return "" + getAmount();

}

}

Hey, was ist das? Programmieren, ohne einen Test dafür zu haben? Tja, nun, diese Methode ist so einfach, daß ein Test daran meines Erachtens verschwendet wäre.

-

- Beobachten Sie den Return-on-Investment, wenn Sie Tests schreiben. Schreiben Sie nur Tests der Art, die ihren Aufwand wert sind.

Testen wir jetzt, erhalten wir folgende Rückmeldungen:

junit.framework.AssertionFailedError:

sum expected:<3.0> but was:<3.0>

at EuroTest.testAdding(EuroTest.java:30)

junit.framework.AssertionFailedError:

rounded amount expected:<2.0> but was:<2.0>

at EuroTest.testRounding(EuroTest.java:24)

junit.framework.AssertionFailedError:

sum expected:<3.0> but was:<3.0>

at EuroTest.testAdding(EuroTest.java:30)

junit.framework.AssertionFailedError:

rounded amount expected:<2.0> but was:<2.0>

at EuroTest.testRounding(EuroTest.java:24)

Hmmm, seltsam, aber doch kristallklar:

Die assertEquals Anweisung in Zeile 30 unseres Tests greift

intern auf die equals Methode zurück und diese vergleicht

zwei Objekte standardgemäß anhand ihrer Referenzen.

Damit unser Euro Objekt als wirkliches Wertobjekt und nicht

als Referenzobjekt behandelt wird, müssen wir die equals

Methode geeignet überschreiben.

Aber zunächst definieren wir für das gewünschte Verhalten

einen weiteren Test:

public class EuroTest...

public void testEquality() {

assertEquals(two, two);

assertEquals(two, new Euro(2.00));

assertEquals(new Euro(2.00), two);

assertTrue(!two.equals(new Euro(0)));

assertTrue(!two.equals(null));

assertTrue(!two.equals(new Object()));

}

}

Die Implementation der equals Methode sieht in etwa

wie folgt aus:

public class Euro...

public boolean equals(Object o) {

if (o == null || !o.getClass().equals(this.getClass())) {

return false;

}

Euro other = (Euro) o;

return this.cents == other.cents;

}

}

public class Euro...

public boolean equals(Object o) {

if (o == null || !o.getClass().equals(this.getClass())) {

return false;

}

Euro other = (Euro) o;

return this.cents == other.cents;

}

}

Nochmal nachdenken:

Der Java-Standard erwartet von uns, daß wir mit der equals

Methode auch gleichzeitig die hashCode Methode redefinieren:

public class EuroTest...

public void testHashCode() {

assertTrue(two.hashCode() == two.hashCode());

assertTrue(two.hashCode() == new Euro(2.00).hashCode());

}

}

Also:

public class Euro...

public int hashCode() {

return (int) cents;

}

}

public class Euro...

public int hashCode() {

return (int) cents;

}

}

Puhhh... Sie bemerken, daß wir hier zusätzlichen Code schreiben, nur um unsere Klassen zu testen. Das ist interessanterweise nicht mal schlimm. Im Gegenteil, wir werden später sehen, wie das testgetriebene Programmieren unsere Klassen dahin lenkt, daß sie testbarer werden.

-

- Spendieren Sie Ihren Klassen ruhig zusätzliche öffentliche Methoden, wenn sie dadurch leichter getestet werden können.

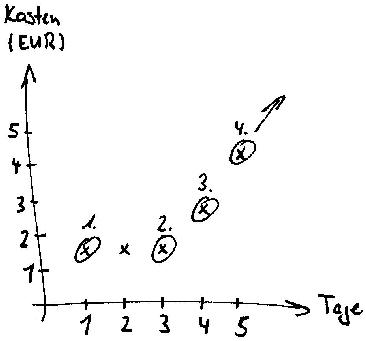

Wow, wir haben zu diesem Zeitpunkt zehn Tests(!) Damit ist die erste Schallmauer durchbrochen. Sicherlich können wir immer mehr Tests schreiben... Wichtig ist, im Auge zu behalten, welche Tests ihren Aufwand wert waren und welche nicht. Die Milchmädchenrechnung geht so:

-

- Schreiben Sie nur Tests für solchen Code, der unter Umständen fehlschlagen könnte.

Testen von Exceptions

Wie testen wir, ob eine Exception folgerichtig geworfen wird?

Die zweite Karte fragt, "Wie geht add mit negativen Beträgen

um?"

Nun, sicherlich ist es schon nicht sinnvoll, negative double

Werte in den Konstruktor der Klasse geben zu dürfen.

Wir sollten deshalb die Vorbedingung des Konstruktors spezifizieren.

Normalerweise würde ich nicht empfehlen, Tests für Vorbedingungen

zu schreiben, doch möchte

ich an dieser Stelle eine Ausnahme machen, weil Sie so mal sehen,

wie Sie mit JUnit Exceptions testen können.

public class EuroTest...

public void testNegativeAmount() {

try {

final double NEGATIVE_AMOUNT = -2.00;

new Euro(NEGATIVE_AMOUNT);

fail("Should have raised an IllegalArgumentException");

} catch (IllegalArgumentException expected) {

}

}

}

Das JUnit-Muster, um Exceptions zu testen, ist denkbar einfach,

nachdem es einmal klar geworden ist.

Wir probieren, ein Euro Exemplar mit negativem Wert zu bilden.

Was wir im Fall einer solchen Verletzung der Vorbedingung erwarten

würden, wäre eine IllegalArgumentException zu werfen.

Wenn der Konstruktor also diese Ausnahme auslöst, kommt der

catch Block zum Tragen.

Der Variablenname der Exception drückt es schon aus, wir erwarten eine

IllegalArgumentException.

Wir fangen die erwartete Exception und alles ist gut.

Wenn der Konstruktor die Ausnahme dagegen nicht auslöst, wird die

fail Anweisung ausgeführt und der spezifizierte Fehlertext

von JUnit in einem AssertionFailedError Fehlerobjekt

protokolliert.

Der fail Methode sind wir bisher noch nicht begegnet.

Sie wird von der Assert Klasse realisiert.

Sie können sie wann immer verwenden, wenn Sie einen Testfall mit einem

Fehler abbrechen möchten.

Abschliessend sehen Sie den angepassten Konstruktor:

public class Euro...

public Euro(double euro) {

if (euro < 0.0) {

throw new IllegalArgumentException("Negative amount");

}

cents = Math.round(euro * 100.0);

}

}

public class Euro...

public Euro(double euro) {

if (euro < 0.0) {

throw new IllegalArgumentException("Negative amount");

}

cents = Math.round(euro * 100.0);

}

}

Schenken Sie Ihrem Testcode unter allen Umständen die gleiche Aufmerksamkeit wie dem Programmcode, der in Produktion gehen soll. Es ist keineswegs unüblich, daß Sie mehr Testcode schreiben werden wie Produktionscode. Unit Tests zu schreiben ist allem voran eine Investition in die Zukunft ihrer Software, die sie durch regelmässiges wie sorgfältiges Refactoring unbedingt aufrechterhalten sollten.

-

- Refaktorisieren Sie Ihren Testcode genauso regelmässig und sorgfältig wie ihren übrigen Code.

Nächstes Tutorial in dieser Serie: Testgetriebene Entwicklung

Danke für Eure Verbesserungsvorschläge

Tammo Freese, Johannes Link, Karsten Menne, Martin Müller-Rohde, Stefan Roock, Andreas Schoolmann und Frankmartin Wiethüchter

Weiterführende Informationen

- Johannes Link: Softwaretests mit JUnit

- Frank Westphal: Testgetriebene Entwicklung mit JUnit und FIT

- JUnit.org: Testing resources for Extreme Programming

-

JUnit Yahoo! Group

:

Englischsprachige Mailingliste

:

Englischsprachige Mailingliste

-

Kent Beck, Erich Gamma:

Test-Infected - Programmers love writing tests

,

Java Report, July 1998

,

Java Report, July 1998

-

Erich Gamma, Kent Beck:

JUnit - A Cook's Tour

,

Java Report, May 1999

,

Java Report, May 1999

Tonabnehmer #1: Johannes Link -

Softwaretests mit JUnit

Zum Auftakt des Tonabnehmers, meiner neuen Audiokolumne zur agilen Softwareentwicklung, sprach ich mit Johannes Link über sein neuestes Buch Softwaretests mit JUnit.

Das Telefoninterview können Sie als MP3 herunterladen oder direkt als Podcast empfangen. (Was ist Podcasting?)

- Download: MP3 (46:11 Min, 10.7 MB)

- Podcast: RSS mit Enclosures

Aus dem Interview erfahren Sie alles Wissenswerte rundum die Testgetriebene Softwareentwicklung. Auf meine Frage, welche Herausforderungen auf uns zukommen, antwortete Johannes: "Das Entscheidende, was wir in den letzten Jahren erlebt haben, ist ein großer Kostendruck auf die Softwareindustrie. [...] Wir müssen herausstellen, dass Testgetriebene Entwicklung nur zu einem kleinen Teil mit Testen und Programmierung zu tun hat, sondern große Auswirkungen auf den Prozess und das Management hat. Denn im Prozess und im Management liegen eben die größten Optimierungspotenziale der Softwareentwicklung. Und dann können wir, wenn wir das rüberbringen, auch vielen, die völlig auf Outsourcing und Offshoring schwören, den Wind aus den Segeln nehmen."

"Wenn ich als Kunde mir einen Dienstleister aussuche, würde ich einen auswählen, der von sich aus automatisierte Testfälle erstellt und die Anforderungen mit mir zusammen in automatisierten Akzeptanztests festhalten will."

Testgetriebene Entwicklung

Eingehen auf Veränderung

Wie würden wir programmieren, wenn wir tatsächlich nicht wüssten, wohin unser Kunde die Entwicklung steuern wird? Wie müssten wir programmieren, wenn wir späte Anforderungsänderungen als Chance oder Wettbewerbsvorteil unserer Kunden und nicht als Risiko der Softwareentwicklung auffassen wollten? In dieser Situation würden wir unser Design inkrementell erstellen und in kleinen Schritten anpassen, während neue Anforderungen auf uns zukommen. Unser Designprozess wäre dem organischen Anpassungs- und Wachstumsprozess ganz ähnlich. Design wäre eine ständige Aktivität, die wir Minute um Minute wahrnehmen würden.

Interessanterweise beschreibt dies zu einem großen Teil unsere tagtägliche Situation in der Softwareentwicklung in heutigen schnelllebigen Märkten, wo viele Projekte in der Tat explorativer Natur sind. Ein Design lässt sich in diesen Fällen nicht vorab planen, sondern kann sich erst mit wachsendem Verständnis der Anforderungen entwickeln. Noch mehr ähnelt die Situation jedoch unseren Aufwänden in der Pflege, das heißt Weiterentwicklung, vorhandener Software. Wie würde sich demnach unsere Perspektive ändern, wenn wir davon ausgehen, dass wir schon die Softwareentwicklung so betreiben können wie Wartungsprojekte? Was müssten wir leisten, damit wir inkrementell und unbegrenzt lange immer neue Funktionen in unsere Programme integrieren können?

Um diesen Gedankensprung in die Realität zu retten, benötigen wir eine qualitätsbewusste Alternative zum vorab geplanten Design. Wir suchen nach einer Strategie, mit der wir verhindern, dass die Codequalität mit wachsender Programmgröße in Mitleidenschaft gezogen wird. Eine vielversprechende Wiederentdeckung ist die testgetriebene Entwicklung, oft auch testgetriebene Programmierung oder gar testgetriebenes Design genannt, wenn auch andere Autoren mit dem Namen zum Teil bestimmte Schwerpunkte der Technik ansprechen. Im Englischen spricht man von Test-Driven Development oder Test-First-Design.

Just-in-time-Design

Testgetriebenes Programmieren ist eine Just-in-time-Designtechnik, um auf Just-in-time-Anforderungen einzugehen. Wir schreiben dabei Unit Tests, noch bevor wir den zu testenden Programmcode schreiben. Idealerweise wird jede funktionale Programmänderung zuvor durch das Schreiben eines weiteren Tests motiviert. Wir entwerfen diesen Test so, dass er zunächst fehlschlägt, weil das Programm die gewünschte Funktionalität noch nicht besitzt. Erst anschließend schreiben wir den Code, der den Test zum Laufen bringt. Auf diese Weise wird die gesamte Programmentwicklung inkrementell durch das unmittelbare Feedback konkreter Tests angetrieben.

Sie fragen sich vielleicht, was wir denn testen sollen, wenn wir noch überhaupt keinen Code geschrieben haben? Doch diese Frage lässt sich umdrehen. Woher wissen wir denn, was wir programmieren sollen, wenn wir noch nicht wissen, was denn überhaupt erforderlich ist? Zuerst die Tests zu schreiben, ist eine Möglichkeit, um herauszufinden, was wir programmieren müssen und was nicht, und wie wir auch sicherstellen können, dass wir tatsächlich programmieren werden, was wir programmieren wollten. Analysieren Sie dazu, wie die erforderliche Klasse funktionieren und sich verhalten sollte. Dokumentieren Sie dann Ihr Verständnis in einem ausführbaren Unit Test. Stellen Sie sich dabei vor, der zu testende Code wäre einfach schon realisiert. Entwerfen Sie die Tests aus der Verwendungsperspektive, so, wie Sie sich die Schnittstelle der zu testenden Klasse wünschen, und verdrängen Sie die Gedanken an die Implementierung für einen kurzen Moment.

Wir sprechen von einer Designtechnik, weil das frühe Testen eine ganze Reihe positiver Auswirkungen auf das resultierende Design hat. Ein Vorteil dieser Technik wird hier schon unmittelbar deutlich. Wenn Sie Ihre Tests zuerst schreiben, wird Ihr Code auch testbar sein. Den Test haben Sie ja schließlich gerade schon geschrieben. Code dagegen, der nicht unter Gesichtspunkten der einfachen Testbarkeit entworfen wurde, läßt sich auch nachträglich meist nur noch schwer testen. Tatsächlich handelt es sich beim Test-First-Ansatz noch stärker um eine Designstrategie als eine Teststrategie. Ich werde zum Ende des Artikels noch auf die Langzeiteffekte dieser Technik zurückkommen.

Testgetriebenes Design ist der linke Fuß unserer evolutionären Designstrategie. Der rechte Fuß ist das Refactoring. Um den inkrementellen Designansatz zu gewährleisten, ist unbedingt eine höchstsäuberlich strukturierte Codebasis erforderlich. Wir müssen sicherstellen, dass wir uns durch kurzfristig getroffene Entwurfsentscheidungen nicht zunehmend in die Ecke malen. Um die innere Qualität des Programms dabei nicht zu opfern, sondern über sehr weite Zeiträume aufrechtzuerhalten, müssen wir das Design durch fortlaufende überarbeitung in Stand halten. Wir verbessern die Struktur des Code durch unzählige kleine Refactorings und führen nach jedem Schritt alle gesammelten Tests aus, um sicherzugehen, dass wir nicht ungewollt das Verhalten des Programms verändert haben. Miteinander kombiniert ermöglichen testgetriebenes Programmieren und anschließendes Refactoring, dass wir entwickeln können, was wir brauchen, wenn wir es brauchen.

Iteratives Testen und Programmieren

Die testgetriebene Entwicklung zwingt uns in einen stark iterativen Prozess, in dem jeder Schritt die Möglichkeit zum Lernen bietet. Jeder Test, den wir schreiben und erfüllen, kann uns konkretes Feedback darüber liefern, welchen Test wir als nächstes schreiben könnten oder sollten. Je kleiner wir dabei unsere Programmieretappen wählen, desto schneller können wir lernen, wohin uns der Weg führt.

Der Zyklus des Testens und Programmierens schaut so aus:

- Wir entwerfen einen Test, der zunächst fehlschlagen sollte.

- Wir schreiben gerade soviel Code, dass der Test tatsächlich fehlschlägt.

- Wir schreiben gerade soviel Code, dass tatsächlich alle Tests durchlaufen.

Diesen Prozess wiederholen wir, solange uns weitere Tests einfallen, die unter Umständen fehlschlagen könnten, bis der Code schließlich seine durch die Tests spezifizierten Anforderungen erfüllt. Anschließend refaktorisieren wir den Code in die einfachste Form, oft jedoch schon früher, um "Platz" für weiteren Code zu schaffen und neue Tests dadurch einfacher erfüllen zu können. Dazu später mehr.

Machen wir mal ein kleines Beispiel.

Angenommen, wir möchten uns die Namen der Kunden eines Videoladens merken.

Um diese Funktionalität zu erreichen, schreiben wir im ersten Schritt einen

neuen Test.

Dieser Test schlägt zunächst fehl, weil sich ein Customer

bisher noch keinen Namen merken kann.

Die Klasse besitzt weder einen geeigneten Konstruktor, noch eine passende

Accessor-Funktion, um den Namen wieder abzufragen.

Um die nötigen änderungen einzufügen, definieren wir den folgenden Testfall.

public class CustomerTest...

public void testCustomerName() {

Customer customer = new Customer("Bent Keck");

assertEquals("Bent Keck", customer.getName());

}

}

Damit dieser Testfall überhaupt durchkompiliert, besteht der zweite

Schritt darin, wenigstens die minimalen Schnittstellenrümpfe in unsere

Customer Klasse einzufügen.

Das überraschende ist jetzt, dass wir die Klasse nicht sofort

ausimplementieren, sondern den Testfall erst einmal mutwillig

fehlschlagen lassen.

Warum wir die Klasse leer lassen, wird Ihnen klarer werden, wenn Sie

auf die Farbübergänge unseres JUnit-Balkens Acht geben.

Noch ist er schön grün...

public class Customer...

public Customer(String name) {

}

public String getName() {

return null;

}

}

Unser Code sollte jetzt fehlerfrei durchkompilieren. Um den zweiten Schritt abzuschließen, machen wir den Test. Unser Testfall sollte fehlschlagen und so tut er es dann auch. Der abgedruckte rote Balken signalisiert, wo immer er auftaucht, dass wir die Tests zu diesem Zeitpunkt ausführen mit dem protokollierten Fehler als Resultat.

junit.framework.AssertionFailedError:

expected:<Bent Keck> but was:<null>

at CustomerTest.testCustomerName(CustomerTest.java:14)

junit.framework.AssertionFailedError:

expected:<Bent Keck> but was:<null>

at CustomerTest.testCustomerName(CustomerTest.java:14)

Im dritten Schritt schreiben wir jetzt endlich den Code, der unseren Testfall erfüllt. Das überraschende hier wiederum ist, dass wir nur gerade soviel Programmcode schreiben, wie unbedingt nötig ist, um alle unsere gesammelten Testfälle zu erfüllen. Der grüne Balken drückt aus, dass der abgedruckte Code unsere Tests passiert.

public class Customer...

public String getName() {

return "Bent Keck";

}

}

public class Customer...

public String getName() {

return "Bent Keck";

}

}

Grüner Balken! Fertig! Nach nur 10 Sekunden, ist das nicht was?

Rollen Sie jetzt bitte nicht mit den Augen, wir gehen ja noch ein Stückchen weiter. Als Nächstes extrahieren wir den Namen in ein eigenes Feld. Moderne IDEs unterstützen dieses Refactoring auf Knopfdruck.

public class Customer...

private String name = "Bent Keck";

public String getName() {

return name;

}

}

public class Customer...

private String name = "Bent Keck";

public String getName() {

return name;

}

}

Wieder ein grüner Balken! Alle Tests laufen! Was machen wir als Nächstes?

Hmm, den Namen des Kunden im Konstruktor im Feld merken?

public class Customer...

private String name;

public Customer(String name) {

this.name = name;

}

}

public class Customer...

private String name;

public Customer(String name) {

this.name = name;

}

}

Erneut bleibt der Balken grün. Sind wir fertig?

Ich würde sagen, unsere kleine Aufgabe ist abgeschlossen, bis zu dem Zeitpunkt, dass wir einen weiteren Test schreiben, der den JUnit-Balken wieder rot färbt.

Was haben wir erreicht? Wir haben eine kleine neue Funktion in unser bestehendes Programm integriert. Wir haben zunächst die einfachste Lösung programmiert, die unseren Test besteht, und haben dann die Struktur des Code umgeformt, nachdem die Tests schon liefen. Wir sind dabei in ganz kleinen Schritten vorgegangen und haben nach jedem Schritt die Tests ausgeführt, um sicherzugehen, dass wir keine bestehende Programmfunktionalität beeinträchtigen. Bemerkenswert ist dabei, dass wir uns solange sicher wiegen können, solange wir genau wissen, aufgrund welcher Zeilen Code sich der Testbalken von grün auf rot oder zurück von rot auf grün verfärbt. Es ist dieser stetige Wechsel der beiden Farben, der uns minütlich über unseren letzten Schritt informiert.

-

- Arbeiten Sie von einem grünen Testbalken aus immer zunächst auf einen roten Balken hin. Arbeiten Sie dann vom roten Balken aus auf dem kürzesten Weg zurück auf den grünen JUnit-Balken. Beim grünen Balken angekommen nehmen Sie die Möglichkeit zum Refactoring wahr.